扫码分享到微信

摘要: 如何用软件算法榨干国产芯片的每一滴性能,KernelCAT的出现,或许意味着中国AI正在补齐“算法—芯片”之间缺失的那块关键拼图。

2026年初,英伟达CEO黄仁勋的中国之行再次成为焦点,但在那张“4.5万亿美元市值”的华丽报表之下,一场关于AI底层话语权的暗战早已悄然升级。

当DeepSeek以惊人的极低成本训练出对标OpenAI的模型,并导致英伟达股价单日蒸发近6000亿美元时,行业终于意识到一个被忽略的真相:堆砌芯片数量不再是唯一的出路,极致的软硬件协同优化才是打破封锁的关键。

然而,对于绝大多数中国企业而言,想要复刻这种“效率奇迹”却面临着一道难以逾越的隐形高墙——CUDA。

算力主权的“最后这层窗户纸”

中国AI产业呈现出一种奇特的“三明治”结构:上层有繁荣的应用生态,下载量数十亿级的APP层出不穷 ;底层有正在奋力追赶的国产芯片(如昇腾系列)。但夹在中间的“软件生态层”,却是一片不得不依赖着CUDA的荒原。

这正是国产AI的阿喀琉斯之踵。

对于开发者来说,国产芯片之所以“难用”,往往不是因为硬件性能不行,而是缺乏高效的算子(Kernel) 。算子是算法与芯片之间的“翻译官”,如果这个翻译官水平仅相当于“机翻”,那么再强的国产芯片也发挥不出理论性能的一半。

传统算子开发如同“戴着手铐修手表”,不仅需要精通芯片架构,还要进行漫长的手工调优。这一极高的门槛,导致国产芯片生态迟迟无法突破,算力主权实际上仍掌握在别人手中。

如果人类工程师写不过来,为什么不让AI自己来写?

KernelCAT:不仅是编程助手,更是“计算运筹专家”

在这一背景下,KernelCAT 的横空出世,堪称中国AI底层工业革命的一声号角。

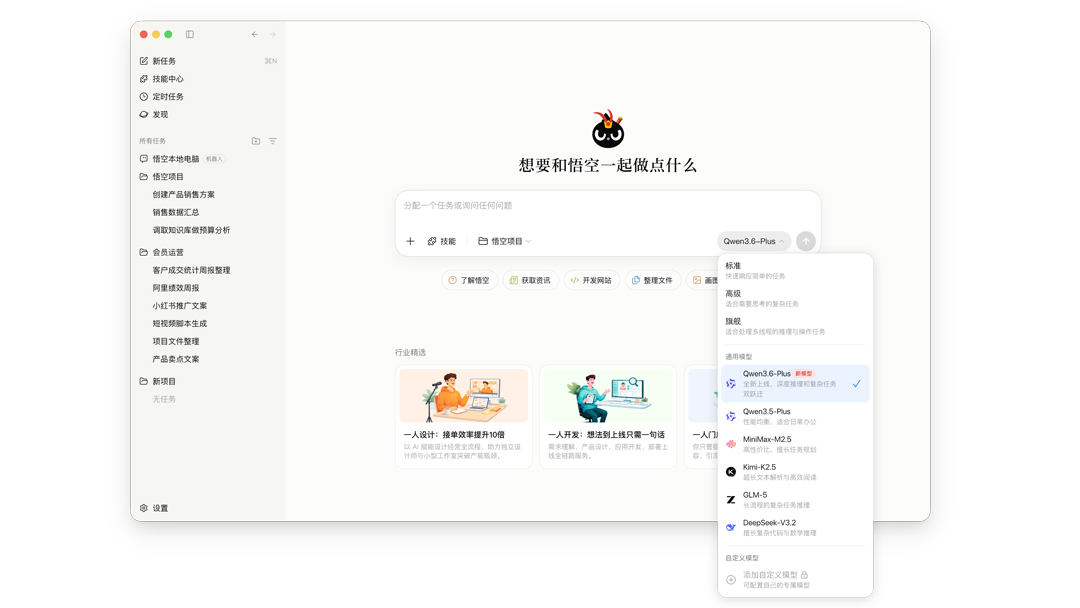

不同于市面上那些只会写写Python脚本的普通Copilot,KernelCAT是一款专为解决“计算加速”难题而生的全栈Agent 。它不仅提供CLI终端和桌面版两种形态,更具备一种独特的核心能力:将大模型的语义理解与运筹学的数学优化相结合。

KernelCAT CLI模式

KernelCAT桌面端

用数学对抗经验,实现性能反超

在以往,算子调优全靠资深工程师的“经验”和“直觉”,就像老中医抓药。而KernelCAT引入了运筹优化算法,将参数调优变成了一个可计算的数学问题。

实测数据最能说明问题:在华为昇腾芯片上运行FlashAttentionScore算子时,KernelCAT自动进行了十几轮迭代搜索,迅速锁定了最优配置。

• 延迟降低:最高达22%

• 吞吐量提升:最高近30%

• 对比结果:在向量加法任务测试中,KernelCAT生成的算子性能全面超越了华为官方封装的商业化黑盒算子。

这意味着,AI已经不仅能写代码,还能写出比人类专家更高效的底层核心代码。

把“版本地狱”变成“一键部署”

除了极致性能,KernelCAT解决的另一个痛点是国产环境的迁移适配。

任何尝试过在国产NPU上部署开源大模型的人,大概都经历过由torch、torch_npu和vLLM版本不兼容带来的“依赖地狱” 。DeepSeek-OCR模型的国产化部署就是一个典型案例。

KernelCAT展现了惊人的自动化能力:

• 自动破局:在没有源码依赖的情况下,精准识别版本互锁矛盾,从零搭建稳定环境。

• 深度修补:自动识别硬件缺陷,手动重构SDPA兼容类并修补MoE结构,让模型在国产芯片上流畅运行。

• 百倍加速:通过引入RoPE融合算子等优化,将vLLM的推理吞吐量提升至3057 toks/s,相比传统方案实现了139倍的惊人加速。

过去需要顶尖团队耗时数周的适配工作,现在被缩短至小时级 。这不仅仅是效率的提升,更是将国产芯片从“能用”变成了“好用”。

结语:重塑生态的起点

黄仁勋曾直言:“我们创立英伟达,是为了加速软件,芯片设计反而是次要的。”这句话揭示了一个关键真相:在现代计算体系中,软件才是真正的护城河。英伟达的持续领先,源于其从底层算法出发、贯通架构与编程模型的全栈掌控能力。

长期以来,“天下苦CUDA久矣”是一句无奈的叹息 。但随着KernelCAT这样的内核级编程Agent出现,我们看到了一种新的可能:利用AI本身的能力,去构建属于中国芯片的高性能软件生态。

当国产芯片不再受困于算子匮乏,当模型迁移不再需要数周的阵痛,中国AI产业才能真正实现从应用层到底层的全链路闭环。

这场关于底层算力的突围战,KernelCAT已经率先掀桌,而好戏才刚刚开始。

体验计算加速的未来:KernelCAT现已开启限时免费内测,支持CLI与桌面双模式。

4.9 亿次刷屏 CES!元萝卜凭中国智造影响全球家用机器人格局

产品出海成为中国科技品牌出海的亮眼样本作为实现家用 AI 机械臂量产的品牌才能在国际市场中真正打响其产…

2026-02-02 11:24