扫码分享到微信

3月31日凌晨4:23,安全研究员Chaofan Shou在X上发帖:Anthropic的Claude Code安装包里藏着一个59.8MB的source map文件,十几行脚本就能还原51万行核心源码。

5月14日,彭博社报道:OpenAI正在与外部律所合作,准备起诉苹果违约。

两条消息间隔45天,但撕开的是同一道伤口——2026年5月的AI权力更替,旧王被围猎,新王也不安全。

更微妙的是,它们指向同一个结构性问题:旧王赖以起家的东西不值钱了,新王赖以登顶的东西不安全。OpenAI的9亿用户没能换来等价的商业回报,Anthropic的"安全"信仰正在被自己的技术栈攻破。

OpenAI的三面围城

Sam Altman大概没想到,苹果会是第一个背叛的人。

2024年6月,他亲赴苹果园区,和Craig Federighi一起站在台上。苹果称OpenAI为"人工智能领域的先驱与市场领导者"。当时OpenAI内部估计,这个合作每年能带来数十亿美元的订阅收入——可以对标苹果与谷歌每年数百亿美元的Safari搜索协议。

现实是另一回事。苹果的集成方式要求用户必须对着Siri说出"ChatGPT"才能触发,结果展示在狭小的窗口里,功能远不如独立App。OpenAI委托的用户调研显示,苹果用户宁愿直接打开ChatGPT应用,也不愿通过Siri调用。一位OpenAI高管对彭博社说:"我们在产品层面已经尽力了,但他们没有。更糟的是,他们连诚意都没有。"

2026年1月,苹果与谷歌签下每年约10亿美元的多年期协议,用Gemini构建下一代Siri。iOS 27将在6月的WWDC上开放第三方AI模型接入——Claude和Gemini都会出现在Siri的模型选择器里。OpenAI从"独家伙伴"变成了"之一"。5月14日,彭博社报道OpenAI正在准备对苹果发出违约通知函。

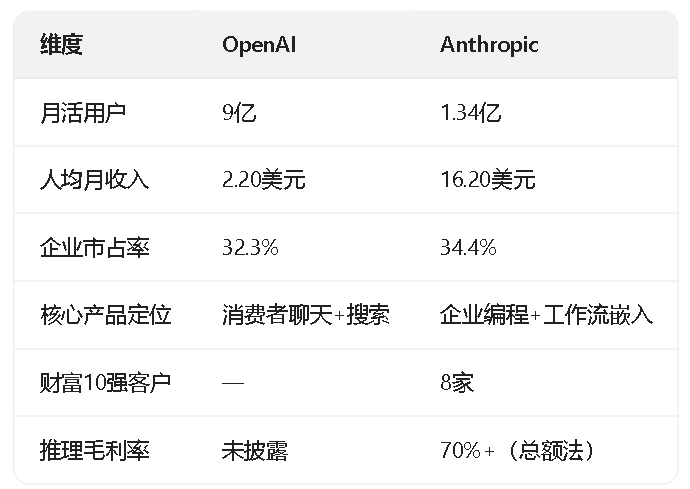

苹果的背叛只是东线。南线,马斯克的诉讼已进入陪审团结案陈词阶段,潜在赔偿金额高达1500亿美元。西线,Anthropic正在吞噬企业市场——Ramp 5月AI指数显示,过去12个月企业AI支出中Anthropic的相对份额从约10%跳到了65%以上。

屋漏偏逢连夜雨。OpenAI自己的供应链也出了问题——TanStack开源库遭攻击,2台员工设备被入侵。这发生在一个正在冲刺企业市场的公司身上,信号不太好。

OpenAI的回应是成立DeployCo——初始投资40亿美元的部署公司,收购AI咨询公司Tomoro,要把150名工程师直接"嵌入"客户内部。从"卖模型"到"卖解决方案",直接对标Claude Code的企业渗透策略。但OpenAI做的每一个动作,Anthropic至少领先了6到12个月。

Anthropic的悖论:安全公司不安全

就在Anthropic登顶企业市场的同时,两重危机正在撕扯这家公司的核心叙事。两重危机看似无关,但合在一起,指向同一个讽刺:卖安全的公司,自己的安全是最薄弱的环节。

第一重:源码裸奔,而且是自己写的代码出卖了自己。

3月31日,安全研究员Chaofan Shou发现,Anthropic发布到npm的Claude Code包里藏了一个59.8MB的source map文件。一个十几行的脚本就能还原出51.2万行TypeScript源码、1906个文件、40个工具、101个命令。这不是黑客攻击,是一个.npmignore配置疏忽。

最讽刺的不是泄露本身,而是泄露的代码是怎么写的。Claude Code开发负责人曾公开表示:"我对Claude Code的100%贡献都是由Claude Code写的。"这意味着泄露的51万行代码本身就是AI生成的——代码风格、架构选择、甚至那个漏掉.npmignore配置的疏忽,都带着AI编码的指纹。Hacker News上的评论一针见血:这是"just vibes"时代的标志性作品。

一个靠安全信仰估值万亿的公司,核心产品的代码是AI写的,代码的泄露原因是AI生成代码的包装疏忽,泄露的代码里还包含一个专门防内部信息泄露的"Undercover Mode"子系统——他们花了大量工程精力防止AI在git commit里暴露内部代号,结果整个源码随一个.map文件全送了出去。

这不是第一次。2025年初就出过一次同样的Source Map泄露,Anthropic悄悄撤了包修了问题。这次又犯。同一个坑,踩了两遍。

泄露暴露的不仅是产品架构,更是底牌。KAIROS——一个后台常驻的AI守护进程,能在开发者犯错的瞬间主动介入修复,源码中被引用超150次;autoDream——终端闲置时启动的"AI梦境系统",像人做梦一样回溯和巩固当天的工作。这些是Anthropic计划未来数月甚至数年才推出的功能,底牌被掀了个干净。

社区反应极快。韩国开发者Sigrid Jin两小时内启动了Claw Code净室重写,仓库获得75,000 GitHub Star——可能是GitHub历史上增长最快的仓库。AI安全公司Straiker警告,攻击者现在可以研究Claude Code四阶段上下文管理管道中的数据流,找到以前不可见的攻击向量。功能标志和产品路线图已经暴露给了Copilot、Cursor等每一个竞争对手。

第二重:与亚马逊的"灭绝条款"——安全到底值多少钱?

4月21日,亚马逊宣布向Anthropic追加投资,上限250亿美元。作为对价,Anthropic承诺未来十年在AWS上支出超1000亿美元。三天后,谷歌跟进,现金100亿加里程碑奖金上限400亿。SpaceX开放Colossus 1数据中心的22万块GPU。

但谈判的另一面很少有人关注。亚马逊要求获得Claude模型的无限制商用权利。Anthropic的回应是坚持写入"关停条款"——一旦检测到AI系统出现失控或对人类构成生存性威胁的迹象,有权立即关停模型训练或限制商业应用场景。

这是人类商业史上第一次,AI安全从学术讨论变成了合同条款。

但问题跟着来了:谁来判断"失控"的阈值?谁来按下关停按钮?亚马逊能接受一个花了250亿美元投资的模型,被合作方单方面关停吗?Dario Amodei曾公开估算,AI导致人类文明走向极端负面结局的概率约为25%——如果按这个概率,理论上每四个模型版本就有一个应该触发关停。投资人会接受这种概率吗?

更微妙的是马斯克在SpaceX协议中保留的条款:"若Anthropic的AI做出危害人类的行为,SpaceX有权收回算力。"这看起来是安全声明,实际上是一个实质性的控制权安排——Anthropic的算力命脉掌握在一个随时可以拉闸的人手里。

两条危机线拉扯出的核心矛盾是:Anthropic靠"安全"信仰赢得了万亿估值和企业客户,但"安全"在商业现实中是双向的——它既是客户愿意付溢价的原因,也是合作伙伴要求你让步的理由。源码泄露证明了安全机制本身不安全,合同博弈证明了安全承诺在资本面前会让步。当安全和商业利益冲突时,哪一边会先退?

为什么是企业工作流,而不是用户规模

OpenAI和Anthropic的此消彼长,表面上是两家公司的竞争,背后是AI行业估值逻辑的根本性切换。

旧逻辑:谁用户多谁值钱。9亿月活,ChatGPT是全球流量最大的AI产品。消费互联网的估值框架里,用户规模就是护城河。

新逻辑:谁嵌入企业工作流深谁值钱。Claude Code的渗透不是"让开发者在聊天框里问问题",而是从需求分析、编码、重构、测试到部署,每一个环节都有它的身影。一旦企业的开发流程迁移到Claude Code上,切换到Cursor或者Copilot不只是换个工具,是重新训练整个团队的工作习惯。

这就是为什么Anthropic的推理毛利率能从38%飙到70%——企业客户粘性强,议价能力弱,价格敏感度低。也是为什么OpenAI的9亿用户在企业市场里转化不了等价的商业价值。聊天是浅层交互,编程是深度嵌入。浅层交互的替换成本几乎为零——今天用ChatGPT,明天用Gemini,用户感知差别不大。深度嵌入的替换成本极高——换掉Claude Code意味着重写整个开发流程。

苹果和OpenAI的合作破裂,恰好是这个逻辑的反面教材。OpenAI以为自己拿到了"入口级"的分发,但苹果只给了一个"设置菜单级"的入口。没有深度嵌入,9亿用户也转化不了商业回报。

脆弱的新秩序

Anthropic的新王座并不像看上去那么稳固。

算力是第一个隐患。OpenAI预计到2030年将拥有约30吉瓦算力,Anthropic到2027年底预计只有7到8吉瓦——差了将近4倍。Anthropic的应对方案是"宗主国"结构——亚马逊提供Trainium芯片和AWS算力,谷歌提供TPU产能和云平台,SpaceX开放Colossus 1。每一方都有自己的算盘。亚马逊要用Claude填满Trainium芯片的产能,谷歌要借Anthropic牵制微软与OpenAI的联盟,SpaceX要给闲置的Colossus 1找租金回报。

Anthropic拿到的每一分钱都带着回扣条款——融资必须以千亿美元量级花回投资方的云服务和芯片上。Bank of America测算,2026年Anthropic向AWS和谷歌支付的渠道分成将达64亿美元,比2025年的19亿美元增长两倍多。亚马逊和谷歌一季度"令人惊艳的AI利润"中,近一半来自所持Anthropic股权的账面增值,而非自身经营。这是一条脆弱的利益链——只要Anthropic的估值故事讲不下去,宗主国体系就会出现裂痕。

估值口径是第二个隐患。1.2万亿的估值来自链上Pre-IPO市场的隐含估值,2月最近一轮融资的投后估值是3800亿美元,差了3倍多。年化收入口径也存疑——Anthropic用总额法,OpenAI用净额法。分析师Paul Dresser测算,统一到净额口径后,Anthropic的约220亿美元低于OpenAI的250亿美元。70%的推理毛利率如果将模型训练成本完整计入,可能大幅缩水。

安全悖论是第三个隐患,也是最根本的。Anthropic的万亿估值建立在一个前提上:客户为"安全"付溢价。但源码泄露已经证明,安全机制本身可以被一个配置文件打穿。合同博弈正在证明,安全承诺在资本面前会让步。如果企业客户开始追问"你的安全到底安不安全",整个估值叙事都会动摇。而Anthropic的竞争对手们——刚刚看到了它的全部底牌。

写在最后

2026年5月的AI权力更替,不是一部英雄史诗,更像一出悖论剧。

OpenAI被围猎,不是因为它变弱了,而是因为消费互联网的估值框架在AI企业市场中失效了。9亿用户的规模优势在"谁控制工作流"的新游戏里,远不如Claude Code的工程嵌入深。苹果的背叛撕开了一个更深的伤口:当你的核心资产是用户规模,而用户规模的分发权掌握在平台手里时,你永远是被动的那个。

Anthropic登顶,不是因为它安全,而是因为企业客户为"安全承诺"付了溢价。但源码泄露和合同博弈正在证明,安全这个卖点的地基并不牢固。当你卖的就是安全,而安全本身被攻破时,你的整个估值叙事都会动摇。

真正的教训藏在更深一层:AI行业的权力更替,从来不是因为谁赢了模型竞赛,而是因为游戏规则变了。上一轮规则是"谁用户多谁赢",这一轮变成了"谁嵌入深谁赢"。但没有人能保证,下一轮不会变成"谁算力多谁赢"。

7到8吉瓦对30吉瓦。1.2万亿的隐含估值对3800亿的实际融资估值。卖安全的公司,连自己的源码都护不住。

这些数字的缝隙里,藏着新秩序的裂缝。(文/王子祺)